Có bao giờ bạn muốn một nội dung hay liên kết nào đó của trang web mình không xuất hiện trên Google không? Nghe có vẻ hơi ngược đợi, nhưng thực tế thì có đó. Đó là khi bạn không muốn những thông tin mật nội bộ bị index hay đơn giản là giảm sức sử dụng băng thông cho website.

Robots.txt sẽ giúp bạn hiệu chỉnh điều này. Hãy cùng LPTech hiểu về Robots.txt và cách tạo tệp chuẩn SEO để tối ưu SEO website hiệu quả hơn nha.

Robots.txt là gì?

Robots.txt là các tập tin có đuôi txt chứa các câu lệnh điều hướng của website. Các bots của Search Engines dựa vào đây để thu thập đúng những dữ liệu mà chủ website mong muốn indexing.

Một website chuẩn SEO là website được thiết kế có các chức năng tự động tạo Sitemap và Robots.txt vì nếu không có Robots.txt bạn sẽ không thể SEO trang web mình tốt được.

Thiết lập Robots.txt là cách để các webmaster quản lý lưu lượng crawl dữ liệu và ngăn các tệp hình ảnh, video và âm thanh xuất hiện trong kết quả tìm kiếm của Google.

Sau khi Google đọc xong file robots.txt thì sẽ qua sitemap.xml vậy nên tích hợp Robot.txt và Sitemap.xml cùng nhau sẽ giúp bot nhanh chóng thu thập dữ liệu và lập chỉ mục tốt hơn.

Vì sao Robots.txt lại quan trọng trong SEO?

Trong bài hướng dẫn trước của LP Tech về cách hoạt động của Google, thì bạn sẽ biết rằng trong quá trình thu thập thông tin và lập chỉ mục, các Search Engines cố gắng tìm những trang có sẵn công khai trên website, mà chúng có thể đưa vào phần chỉ mục của chúng.

Nên khi "nhện tìm kiếm" truy cập website, robots.txt là tệp mà Google truy cập và đọc đầu tiên. Đơn giản hơn, Robots.txt đóng vai trò như người quản gia của trang web bạn, nó sẽ giới hạn quyền truy cập và lập chỉ mục của từng Google Bot vào trang hay liên kết cụ thể. Do đó website bạn không thể thiếu file robots.txt.

Một ví dụ đơn giản, nếu không có Robots.txt chặn đường dẫn đến Admin website, thì có khả năng đối thủ sẽ search ra trang Admin, hack và ăn cắp thông tin web bạn là điều quá dễ dàng.

Ngoài ra, bản chất của Robots.txt này chỉ có quyền cho phép hoặc không cho phép, chứ không có quyền cấm hoặc ngăn chặn tuyệt đối con bót vào những nơi website của mình. Thiết lập Robots.txt và Sitemap.xml đúng cách sẽ góp phần tăng hiệu năng quá trình tối ưu SEO tổng thể:

- Ngăn nội dung trùng lặp xuất hiện trong kết quả tìm kiếm

- Giữ các phần của một trang web riêng tư

- Giữ các trang kết quả tìm kiếm nội bộ không hiển thị trên Kết quả tìm kiếm

- Ngăn công cụ tìm kiếm lập chỉ mục các tệp nhất định trên trang web của bạn (hình ảnh, PDF, v.v.)

- Chỉ định độ trễ thu thập dữ liệu để ngăn máy chủ của bạn bị quá tải khi trình thu thập dữ liệu tải nhiều phần nội dung cùng một lúc

Cấu trúc của file Robots.txt là gì?

Cấu trúc Robots.txt khá đơn giản, là sự kết hợp các từ khóa hay giá trị được xác định trước mà bạn có thể sử dụng. Bao gồm các định dạng cơ bản sau:

User-agent:

Disallow:

Allow:

Sitemap:

User-agent

User-agent đơn giản là tên của robot công cụ tìm kiếm, điển hình như là Googlebot, Googlebot Image, Googlebot News, Googlebot Video,Bingbot...

Sử dụng chỉ thị * sẽ mang ý nghĩa cho tất cả các trình thu thập dữ liệu, hoặc nếu muốn cho phép một trình nào đó, bạn có chỉ định tên tên cụ thể. Ngoài ra trong một tệp Robots.txt có thể gồm một hoặc nhiều nhóm, bắt đầu bằng user-agent kèm với mục tiêu nhóm cụ thể.

Ví dụ:

User-agent: *

User-agent: Googlebot

User-agent: Googlebot-ImageDisallow

Disallow là chỉ thị hướng dẫn các bot không thu thập dữ liệu các URL cụ thể. Trong đó, kí hiệu / mang ý nghĩa cho"toàn bộ trang web" hoặc bạn có chặn truy cập vào các trang, thư mục hay tệp cụ thể.

Ví dụ:

Disallow: /

Disallow: / private_file.html

Disallow: /admin/ Allow

Ngược lại với Disallow, Allow là lệnh dùng để chỉ thị cho biết các trang hay thư mục con nào được phép truy cập. Và lệnh này chỉ dành riêng cho bot tìm kiếm Googlebot.

Ở ví dụ này. LP Tech đã chặn thư mục 1, thư mục 2 nhưng cho phép lập chỉ mục thư mục con 1 trong thư mục 2.

User-agent: *

Disallow: /thumuc1/

Disallow: /thumuc2/

Allow: /thumuc2/thumuccon1/Sitemap

Sitemap.xml là một danh sách các trang trên một website. Khai báo sơ đồ Sitemap.xml trong Robots.txt sẽ hỗ trợ các Search Engines nhanh chóng crawl dữ liệu website bạn và index tốt hơn.

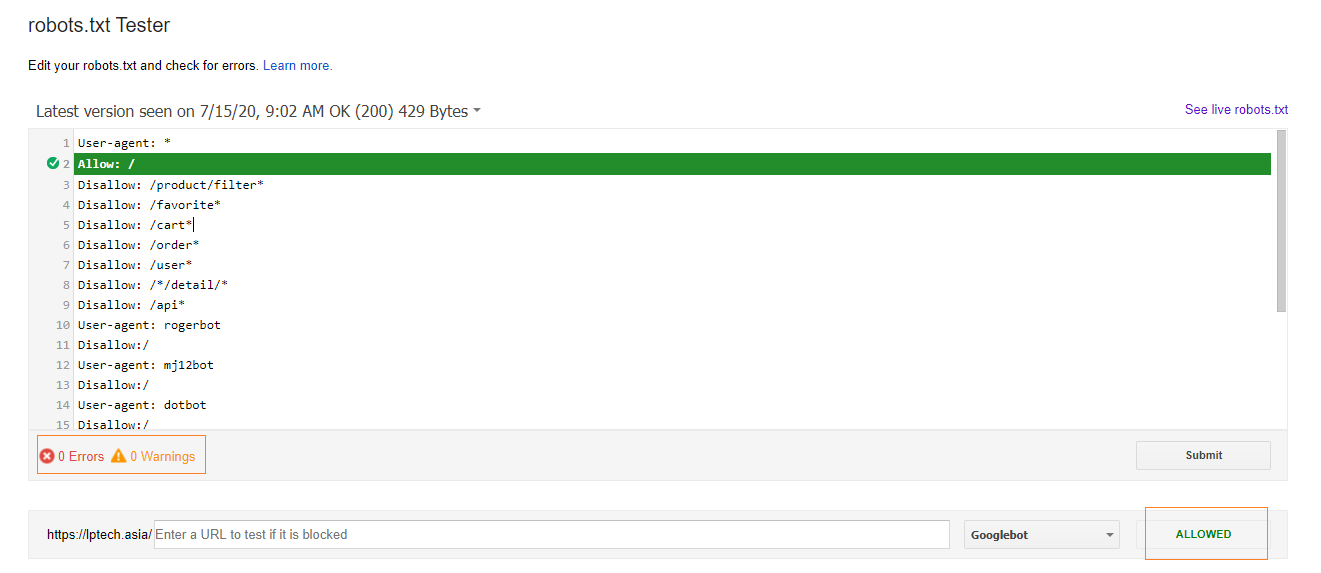

Ví dụ một Robots.txt

User-agent: *

Allow: /

Disallow: /product/filter*

Disallow: /favorite*

Disallow: /cart*

Disallow: /order*

Disallow: /user*

Disallow: /*/detail/*

Disallow: /api*

User-agent: rogerbot

Disallow:/

User-agent: mj12bot

Disallow:/

User-agent: dotbot

Disallow:/

User-agent: exabot

Disallow:/

User-agent: gigabot

Disallow:/

User-agent: AhrefsBot

Disallow: /

User-agent: BacklinkCrawler

Disallow: /

Sitemap: https://lptech.asia/sitemap.xmlCần lưu ý gì khi tạo tập Robots.txt ?

Để có được file Robots.txt chuẩn SEO, bạn cần phải nắm được cấu trúc các lệnh và một vài nguyên tắc khi thiết lập để chính xác và mang lại hiệu quả nha.

- Sử dụng đúng cấu trúc câu lệnh. Nếu các công cụ tìm kiếm không thể hiểu nội dung của tệp tin vì nó có cấu hình sai, họ vẫn truy cập vào trang web và bỏ qua bất cứ điều gì trong robots.txt.

- Cần phân biệt chữ hoa hay thường vì mỗi kết quả sẽ khớp khác nhau

- Không thêm các ký tự đặc biệt khác

- Một câu lệnh nên viết một dòng

- Không được dùng khoảng trắng trước câu lệnh

Cách kiểm tra và xác nhận hợp lệ cho file Robot.txt?

Nếu bạn là chủ một doanh nghiệp, băn khoăn không biết website mình đã thiết lập Rotots.txt chưa thì cách kiểm tra đơn giản nhất đó là hay truy cập theo cú pháp sau:

www.example.com/robots.txt

www.lptech.asia/robots.txtMột cách tốt được các Dịch vụ SEO chuyên nghiệp sử dụng để kiểm tra Robots.txt là thông qua tùy chọn Robots.txt Tester của Google Search Console.

Đầu tiên bạn search trên google "Robots.txt Tester ", truy cập vào đường dẫn và sau đó nhấp vào Open robots.txt Tester. Giao diện kiểm tra của Google Search Console sẽ hiện ra và bắt đầu test.

Nếu mọi thứ đều ổn, nút Test sẽ chuyển sang màu xanh và thay đổi thành ALLOWED. Nếu xảy ra sự cố, đường kẻ gây ra lỗi sẽ được đánh dấu hoặc được hiện thị ở số Warming và Error.

Ngoài ra, nếu bạn muốn thông báo cho Google rằng bạn đã thực hiện thay đổi tệp robots.txt, thi hãy nhấn chọn nút SUBMIT để cập nhật nhé.